Logistic Regression

逻辑回归的假设函数:

其中

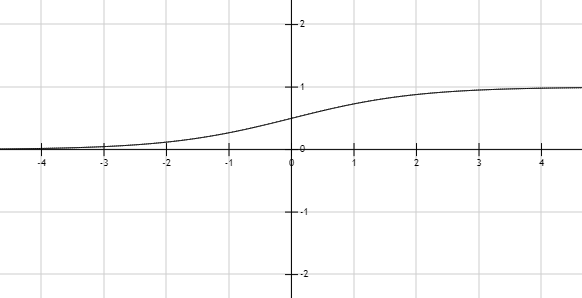

函数图像:

一个机器学习模型实际上是把决策函数限定在某组条件下,这组限定条件决定了模型的假设空间,逻辑回归的假设空间:

它的意思是在给定的

Support Vector Machine

直观理解:将数据点通过某个函数映射到高维空间中(我们称这个函数为核函数),这时寻找一个平面(我们称这个平面为超平面)对空间进行切分,达到同类的数据点在同一面的效果,最后将该平面与空间曲面形成的交线投影到原维度中,得到分类结果。

直观演示视频:https://www.youtube.com/watch?v=3liCbRZPrZA

不定期更新……